200

2

1

1

,

N

i

i

MSE

e

N

где

MSE

– величина среднеквадратичной ошибки для данного

эксперимента между ответом сети и реальной частотой (МГц

2

),

N

– число

точек в данной последовательности частот,

e

– текущая ошибка сети.

Исходя из опыта работ по прогнозированию и восстановлению

численных рядов с помощью методики ИНС для краткосрочных и

долгосрочных прогнозов, ИНС Элмана подверглась модернизации с целью

получать сети разной разветвленности (разное число нейронов и связей).

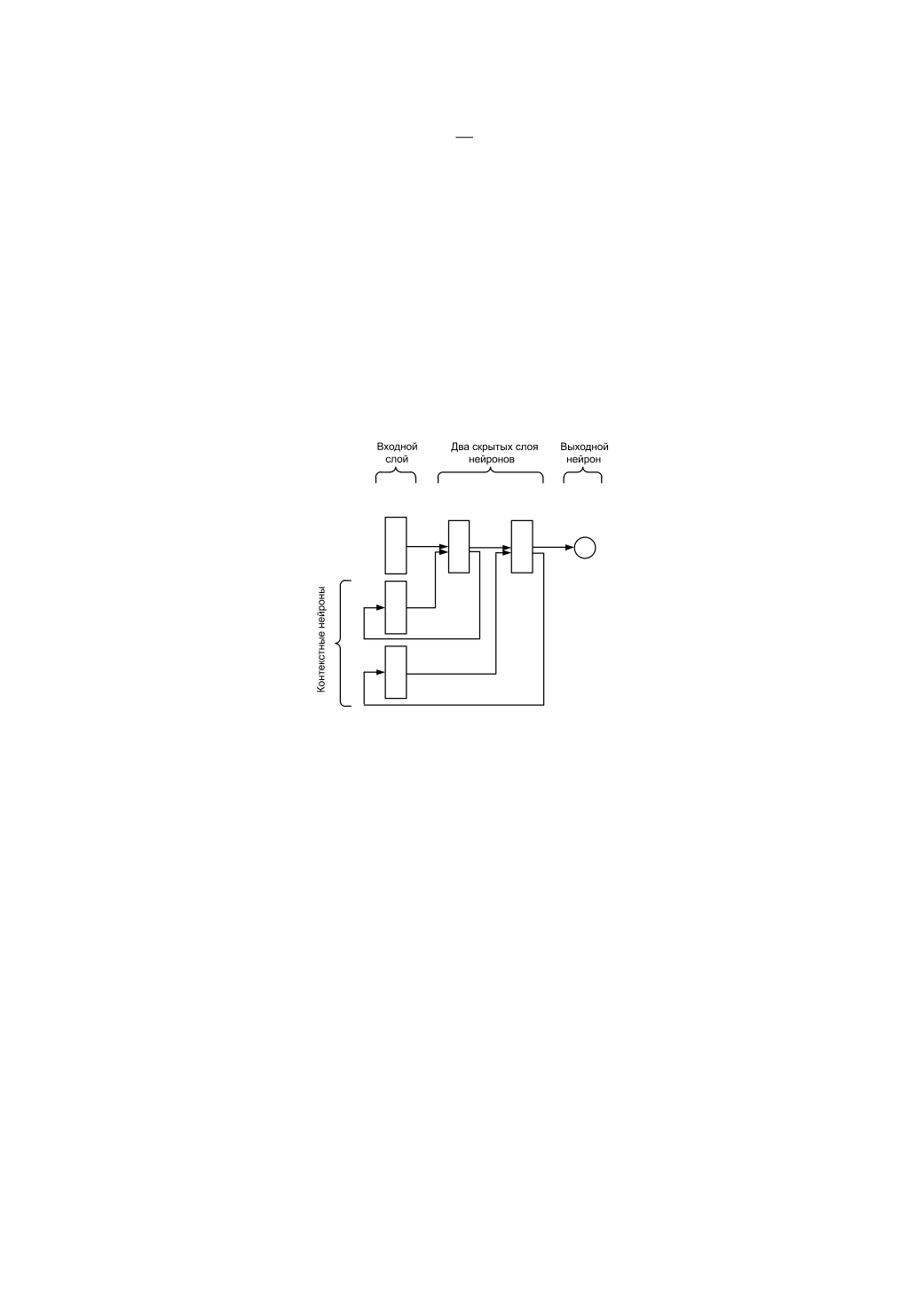

Так была создана двухслойная сеть с одним входным слоем и одним

выходом (рисунок 7.3) с изменяемыми параметрами архитектуры.

Рисунок 7.3 – Архитектура разветвленной ИНС Элмана

Для решения классификационных геофизических задач традиционно

применяется ИНС, построенная по принципу самообучения. Обучение

без «учителя», как и в случае обучения с «учителем», заключается

в подстройке весов синапсов. Очевидно, что подстройка весов может

проводиться только на основании информации, доступной в нейроне, то

есть информации о его состоянии, уже имеющихся весовых

коэффициентах и поданном входном векторе. Исходя из этого и, что более

важно, по аналогии с известными принципами самоорганизации нервных

клеток построены алгоритмы обучения Хебба и Кохонена. Следует

отметить, что вид откликов на каждый класс входных событий неизвестен

заранее и будет представлять собой произвольное сочетание состояний

нейронов выходного слоя, обусловленное случайным распределением

весов на стадии инициализации. Общая идея данных алгоритмов

заключается в том, что в процессе самообучения путем соответствующей

коррекции весов усиливаются связи между возбужденными нейронами.